Storie a puntini

Senti il ritmo con le tue mani

Ruba il ritmo finché puoi, uomo dei cucchiai

C. Cornell ( Spoonman, Soundgarden)

Io sono Michele Bondanelli

Architetto BIM Specialist esperto in restauro architettonico e ti do il benvenut@ su Pensieri OutOfBIM

La newsletter che parla di tecnologie digitali nel mondo del restauro e della professione di architetto.

Come la scadenza di Inarcassa anche questo settembre è stato presentato un nuovo ennesimo modello di iPhone. Il 15!

Il tema interessante che mamma Apple pone è la permanenza operativa di un oggetto tecnologico. Che si lega al concetto di tempo nell’era digitale.

Il piccolo mondo a cui apparteniamo non è certo il fattore trainante delle decisioni di sviluppo tecnologico ma di certo ne sta traendo enormi benefici. Si tratta a mio avviso di porsi alcune domande fondamentali prima di laciarsi andare all’investimento in un nuovo oggetto tecnologico.

Ecco quelle che mi pongo io:

Cosa voglio farci e come voglio usarlo? Per me l’iphone è il centro nevralgico della giornata lavorativa, non per le email, non per i social ma come agenda, accesso ai documenti di progetto e di cantiere, prendere note, scrivere appunti ( anche vocali), piccoli schizzi ma soprattutto strumento di acquisizione sempre con me ( misurare, scansionare, fotografare)

Quale tempo di obsolescenza gli chiedo? Queso fattore è direttamente correlato alla galassia del sistema tecnologico a cui lo smartphone appartiene ( PC, MAC, strumenti, macchine fotografiche ecc). Oggi credo che abbiamo dati ed esperienza per sapere che l’obsolescenza di marketing fissata dai grandi player è di 12 mesi ma almeno per me è impensabile investire in tecnologia con tempi così stretti. Mediamente possiamo quindi definire che il vero salto tecnologico si aggiri attorno ai 4 anni. La compatibilità software invece possiamo attestarla a qualcoa di più anche se la tendenza è quella di avvicinarsi ai 4-5 anni. Il mio worlflow è basato su uno sviluppo incrementale di 6 anni leggermente superiore alla tendenza del mercato, più per questioni di portafoglio che altro!

Cosa ci posso fare ora e cosa ci potrò fare? E’ la domanda delle domande. Nel senso che dobbiamo avere ben chiari i limiti operativi della tecnologia che attualmente usiamo ed aver raggiunto la cosapevolezza di utilizzarla al 80% per i nostri scopi. Perchè 80%? perchè come sostiene Yvon Chouinard

Mi piace dedicarmi con passione a uno sport o a un'attività fino a raggiungere un livello di competenza pari a circa l'80%. Andare oltre richiede un'ossessione che non mi attira. Una volta raggiunto il livello dell'80%, mi piace partire e fare qualcosa di completamente diverso

Il cosa ci potrò fare è da interpretare come una visione di uso del dispositivo tecnologico. Si tratta di fare un focus su quali attività vogliamo protare su dispositivi smart e tentare di capire la direzione che sta prendendo il mondo digitale. Oggi gestire un drone, un rover GNSS, un laserscanner terrestre è la quotidianeità, possiamo prendere misure come se fosse un disto, possiamo acquisire dati LiDAR, possiamo fare fotogrammetria. Tutto questo sarà mgigliorato e portato a livelli decisamente professionali. Quello che ci aspetta è l’integrazione con tecnologie immersive ( l’AI, il machinelearning e tutto quello che viene difinito come intelligenza artificiale è già realtà) per quanto poco appetibile attualmente nel mercato globale il Vision Pro ha dettato la via.

L’investimento economico ha una sua sostenibilità? Stiamo parlando di cifre importanti, in contesti professionali dove licenze software, hardware e spese correnti hanno il loro peso. La ricerca della sostenibilità dell’investimento è anche frutto delle risposte che darò alle precedenti domande. Nel senso che se riscontro che sia ora che nel prossimo futuro ( 1, 2 o 3 anni) la nuova tecnologia non mi prota un effettivo aumento della qualità e miglioramento del workflow bhè… che senso ha introdurre un uovo modello. Lo stesso vale se ciò che ho a disposizione non lo utilizzo alla sua massima possibilità! Se invece riscontro che il salto tecnologico sia decisamente significativo si deve valutare la spesa. E qui ognuno farà i conti nelle prorpie tasche. Mi sento però di darti un consiglio: in questa fase metti a confronto l’ultimissimo modello e uno usato.

Veniamo quindi a bomba.

Comprerei il nuovo iPhone15proMax?

No.

Nonostante il modello proMax porti interessanti novità tecnologiche nel sistema di lenti e nell’apparato fotografcio non passerei al modello di settembre 2023.

Per prima cosa il livello delle lenti tetraprismatiche è decisamente alto tanto che si hanno problemi di produzione e quindi difficoltà nell’assemblare il grosso più grosso di casa apple e in secondo luogo perchè manca ancora il salto nel sensore fotografico che dovrà essere messo in conto una volta affinata la produzione del sistema delle lenti. Inoltre mi aspettavo un ugrade al LiDAR che pare non ci sia in termini di densità di acqusizione. Concludendo al momento ci si fa le stesse cose che si fanno con un 12proMAX con un livello incrementale di prestazioni legate solo al cip A17 pro che non incide sostanzialmente nel processo delle app di maggiore utilizzo ( 3Dscannerapp, Notion, Fotocamera, Cyclon Field, Emlid Flow ecc.)

Considerando che iOS17 è compatibile con iPhone 12ProMax ( che si trova nella parte alta della seconda colonna decisamente fuori dalla zona retrocessione) ad oggi valuterei più un usato che un nuovo e aspetterei il sedici o il diciotto o il cinquanta!

Insomma un po come Italia vs Uruguay un primo tempo con tanta acquolina in bocca e una montagna di sofferenza e poi il risveglio di Michele Lamaro al 50esimo del secondo tempo con una asfaltata che nenache ANAS sulla A14.

Pensieri (H)BIM

Nessun pensiero!

Se vuoi ricevere la newsletter direttamente sulla tua mail

Altrimenti iscriviti canale telegram OutOfBIM_feedback per suggerimenti, info, richieste o semplicemente qualche approfondimento delle news della settimana.

In realtà ne avrei troppi, ho decisamente scritto troppo e francamente me lo tengo per momenti di crisi editoriale!!!

Però ti faccio una domanda

Dopo 6 anni di HBIM la risposta che spunterei è la seconda!

Lo-Fi

Seconda parte di RealityScan la app per dispositivi mobili, sia iOS che Android, sviluppata da Epic Game che “consente di creare modelli 3D ad alta fedeltà”.

Dove trovo RealityScan?

Come ti ho detto nella newsletter #29 Reality Scan è una app per dispositivi mobili dotati di fotocamera siano essi iPhone e iPad con iOS 16 o versioni successive o telefoni e tablet Android che supportano ARCore ed eseguono Android 7 (livello API 24) o versioni successive.

RealityScan is a free-to-download mobile app

La landingpage è: https://www.unrealengine.com/en-US/realityscan

Li troverai i collegamenti per Apple store, Google play e Galaxy Store

Direttamente da dispositivo mobile puoi ricercare RealityScan oppure lo sviluppatore Unreal Engin

L’icona di riferimento è questa

Come funziona

La app quindi può essere scaricata liberamente ma per avviarla serve un account Epic Game ( lo stesso che potrai usare per Reality Capture e Unrial Engine) e un account Scketchfab. Quando carichi per la prima volta su Sketchfab, verrai automaticamente aggiornato a un account Sketchfab Pro per un anno intero poi… dovrai scegliere un piano di abonamento con Scketchfab.

RealityScan infatti lavora in maniera indissolubile con Sketchfab.

In sintesi si compone di quattro fasi:

Acquisizione del dataset fotografico

Matching

Elaborazione del modello

Esportazione

La prima fase è caratterizzata dalla realizzazione di immagini fotografiche. L’app utilizzerà l’obiettivo principale del dispositivo, nel caso di un iPhone con tre obiettivi utilizzerà il grandangolo da 24mm (1x).

La seconda fase, che teoricamente avviene in contemporanea all’acquisizione delle foto, è il matching cioè la ricerca delle corrispondenze tra le diverse fotografie.

Una volta terminato il dataset, cioè quando decidiamo che abbiamo eseguito sufficienti immagini ( attenzione non possiamo superare il limite di 200 scatti) RealityScan procederà all’elaborazione della mesh e del modello texturizzato. L’elaborazione avviene in cloud cioè la app caricherà su server Unreal o Epic, al momento non ho capito bene, dove procederà all’elaborazione con algoritmi di computer vision ( rimango sul generale perchè non ho ancora compreso se sono structure for motion o altro tipo). Terminata l’elaborazione vedremo sul nostro dispositivo un’anteprima.

Ultimo passo è la fase di esportazione verso Sketchfab dove potremmo poi distribuire online il modello, scaricarlo in .fbx o creare scene AR/VR.

Strumenti, setting e parametri

Gli strumenti e i parametri di settaggio sono veramente minimi.

Dal menu impostazioni possiamo sceglier tra due livelli di qualità (Quality) dell’elaborazione:

A) Smooth. Genera un modello molto velocemente ma con livello di dettaglio basso e una mesh con pochi poligoni

B) Detailed. Genera un modello ad alta fedeltà e una mesh con molti poligoni. E’ generalmente una elaborazione lunga dipende dalle prestazioni del dispositivo.

Ad oggi utilizzo sempre il livello Detailed anche se dalla versione 1.1.1.117 iPhone si surriscalda paurosamente.

Poi abbiamo due parametri legati all’uso e cosnumo di dati di traffico internet.

Il primo è Offline Mode che se abilitato di fatto consente di acquisire il dataset e poi successivamente quando rientriamo in studio eseguire gli altri step evitando così di “consumare traffico dati”.

Il secondo è Data usage cioè se vogliamo usare solo una connessione Wi-Fi oppure sia Wi-Fi che rete Mobile. La scelta qui è dettata dal tuo piano tariffario del traffico dati, ti posso dire però che ho riscontrato qualche difficoltà con la sola opzione Wi-Fi attivata, far partire l’elaborazione è stato macchinoso e spesso la app andava in crash.

Non possiamo controllare nessun altro parametro.

Come anticipato RealityScan utilizzerà la focale a 24mm, o comunque la principale, per la quale non è consentito nessun controllo dei parametri fotografici ne il tipo di file di registrazione. Realityscan ad oggi non consente di vedere e salvare il datast nella libreria delle foto di iphone, le mantiene legate al progetto di acquisizione, e questo secondo me è un grosso limite. Così come è un limite il numero massimo di immagini che possiamo utilizzare per un dataset, 200.

Possiamo controllare il matching in forma visuale. Cioè controllando che tutte le aree del soggetto che stiamo rilevando siano verdi o quantomeno non rosse. Se ci accorgiamo che qualche parte è scoperta cioè non è verde possiamo aggiungere delle immagini per migliorare la corrispondenza. Vale comunque il prncipio della fotogrammetria, ricercare una sovrapposizione non inferiore al 60% tra una immagine e la successiva.

Non possiamo controllare nessun parmetro di meshatura e di texturing ma devo dire che il risultato è sorprendente.

Il bello di RealityScan è che ci pensa tutto la app e il servizio cloud.

Nelle prossime newsletter ti parlerò di:

Dimensione del sensore, Overlap e centro di distanza

Come acquisire i dataset fotografici

Prova sul campo, acquisizione di un elemento architettonico ( da un mio progetto in corso)

Processamento del dataset e ridimensionamento del B-Box

Generazione del modello

Esportazione in Sketchfab

Lezioni del Qubo

Sul blog di Graphisoft Italia sono usciti due interessantissimi articoli che ti suggerisco.

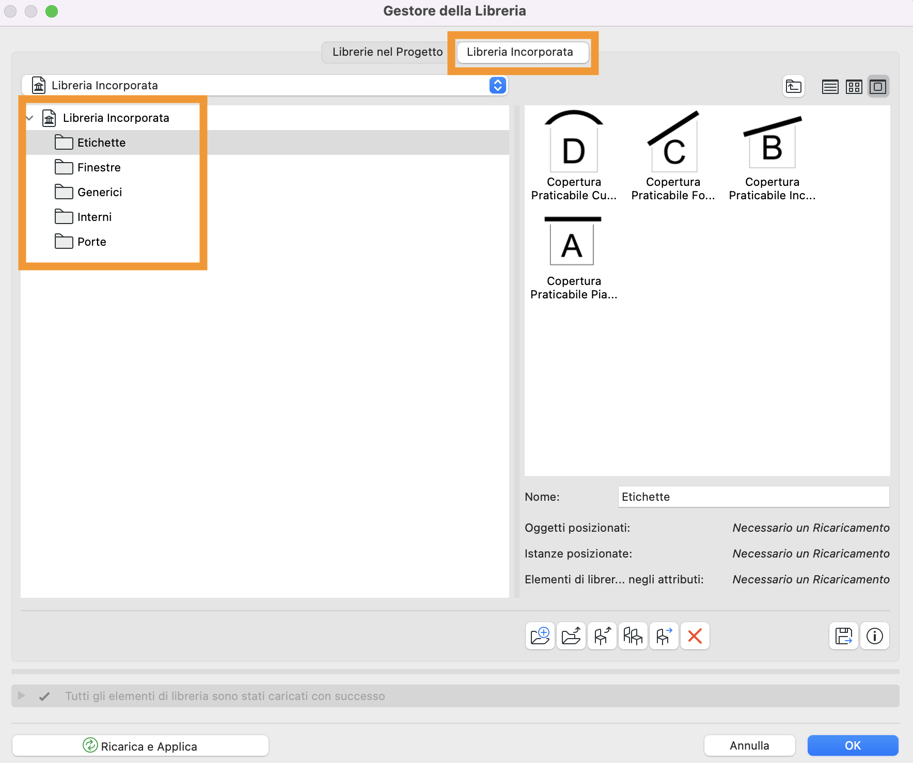

Il primo che ti segnalo è a cura di Mario Napolitano e tratta un argomento fondamentale: la gestione delle librerie.

Il secondo è a cura di Luca Manelli Roberto Marin che fa un riassunto sulla visualizzazione tecnica in Archicad perchè ad oggi comunque la forma espressiva del nostro mestiere è il disegno tecnico.